- Как анализ данных для нейронных машинных переводов помогает создавать еще более точные и качественные переводы

- Что такое нейронные машинные переводы и почему они требуют анализа данных

- Основные этапы анализа данных в NMT

- Этап 1: Сбор и подготовка данных

- Этап 2: Анализ качества данных

- Этап 3: Разметка и сегментация

- Этап 4: Анализ распределения данных

- Инструменты и методы анализа данных для NMT

- Статистический анализ

- Визуализация данных

- Автоматическая проверка ошибок

- Использование мета-данных

- Практические кейсы анализа данных в проектах NMT

- Кейс 1: Улучшение качества перевода технической документации

- Кейс 2: Обработка сленга и неформальной лексики в социальных сетях

- Кейс 3: Балансировка данных для мультиязычной модели

Как анализ данных для нейронных машинных переводов помогает создавать еще более точные и качественные переводы

В современном мире глобализации умение мгновенно переводить тексты с одного языка на другой становится все более важным. Компании, переводческие агентства и разработчики технологий активно ищут новые способы повысить качество машинных переводов. Одним из ключевых направлений в этой области является анализ данных для нейронных машинных переводов (NMT). В этой статье мы расскажем о том, что такое анализ данных в контексте NMT, почему он так важен, и как на практике применяется для улучшения результатов перевода.

Что такое нейронные машинные переводы и почему они требуют анализа данных

Нейронные машинные переводы — это технология автоматического перевода текста, основанная на использовании глубоких нейронных сетей, способных моделировать сложные языковые структуры и контексты. В отличие от традиционных алгоритмов, NMT использует обученные модели, которые «учатся» на огромных объемах параллельных текстов.

Ключ к успешной работе таких моделей, объем и качество данных, на которых они обучаются. Чем больше и разнообразнее источники данных, тем лучше модель улавливает нюансы языка, грамматические конструкции и стилистические особенности. В этом процессе критически важен анализ данных: выявление слабых мест, устранение ошибок, подбор оптимальных обучающих выборок.

| Критерии анализа данных | Описание |

|---|---|

| Качество данных | Проверка правильности и полноты текстов, удаление шумов и ошибок |

| Объем данных | Определение достаточности данных для обучения и тестирования модели |

| Разнообразие источников | Обеспечение широты тематик, стилей, языковых особенностей |

| Балансировка данных | Выравнивание количества примеров для разных типов текстов и языков |

Основные этапы анализа данных в NMT

Работа с данными для нейронных переводов включает несколько ключевых этапов, каждый из которых помогает сделать модель более точной и устойчивой к различиям в исходных текстах.

Этап 1: Сбор и подготовка данных

Прежде всего необходимо собрать максимально полный и репрезентативный набор параллельных текстов. Важными источниками служат открытые корпуса, корпоративные базы данных, профессиональные корпуса текстов и реальные пользовательские запросы.

Этап 2: Анализ качества данных

На этом этапе осуществляется проверка правильности переводов, выявление и исправление ошибок, а также поиск и устранение нерелевантных данных. Используются автоматические алгоритмы и ручной контроль.

Этап 3: Разметка и сегментация

Для обучения модели необходимо разбивать тексты на сегменты, такие как предложения или фразы. Также важно использовать разметку для идентификации имен собственных, чисел, дат и других важных элементов.

Этап 4: Анализ распределения данных

Здесь проводится статистический анализ частотности слов, биграмм, триграмм и других языковых единиц. Это помогает понять, какие структуры встречаются чаще и как лучше балансировать выборки.

Инструменты и методы анализа данных для NMT

Для проведения анализа данных используются разнообразные инструменты, которые помогают автоматизировать и упростить процессы. Ниже представлены основные из них.

Статистический анализ

Использование инструментов для подсчета частоты встречаемости слов, биграмм, триграмм, выявления наиболее распространенных шаблонов и анализ их распределения по корпусу.

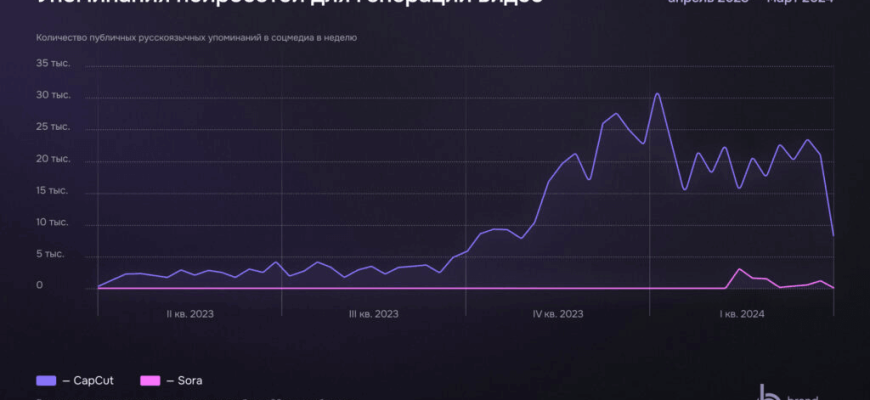

Визуализация данных

Графики и диаграммы помогают понять структуру данных, определить дисбаланс и выявить недостающие сегменты.

Автоматическая проверка ошибок

Программы для обнаружения и исправления ошибок, дубликатов, неправильных переводов и несоответствий.

Использование мета-данных

Анализ метаданных, таких как тема, стиль, уровень формальности, что позволяет формировать более релевантный обучающий набор.

| Инструмент | Описание | Применение | Преимущества |

|---|---|---|---|

| NLTK, SpaCy | Инструменты для обработки и анализа текста | Статистика, сегментация, лемматизация | Быстрое и точное выполнение задач анализа |

| Tableau, Power BI | Визуализация данных | Построение графиков, анализ распределения | Наглядность и выявление скрытых закономерностей |

| Custom scripts (Python, R) | Автоматическая обработка и проверка данных | Обнаружение ошибок, очистка, балансировка | Гибкость и адаптация под конкретные задачи |

Практические кейсы анализа данных в проектах NMT

На практике анализ данных для нейронных переводов применяется в различных ситуациях. Рассмотрим несколько примеров и лучших практик, которые помогут добиться высокого качества перевода.

Кейс 1: Улучшение качества перевода технической документации

Технические документы часто содержат специфическую терминологию и выражения, требующие аккуратного подхода. Анализ данных помог выделить наиболее употребляемые термины, скорректировать разметку и сбалансировать выборки так, чтобы модель лучше понимала профессиональные особенности текста.

Кейс 2: Обработка сленга и неформальной лексики в социальных сетях

Модели, обученные на стандартных корпусах, часто плохо справляются с неформальной лексикой. Анализ данных позволил собрать выборки из социальных сетей, провести кластеризацию и дополнительно обучить модель на специфической лексике, повысив точность перевода в этих областях.

Кейс 3: Балансировка данных для мультиязычной модели

В проектах, где используются несколько языков, важно обеспечить равномерное представление каждого. Анализ распределения данных показал, что один из языков доминирует. После балансировки данных модель стала работать стабильнее и точнее на всех языках.

| Параметр | Значение |

|---|---|

| Объем исходных данных | 10 миллионов пар предложений |

| Объем очищенных данных | 9.5 миллионов пар предложений |

| Процент ошибок в данных перед анализом | 12% |

| Процент ошибок после анализа и очистки | 2% |

| Улучшение качества перевода по метрике BLEU | на 15% |

Основы эффективного neural machine translation — это не только мощные нейронные сети и алгоритмы, но и глубокий анализ данных. Собрание, проверка, разметка и балансировка исходных текстов напрямую влияют на точность, естественность и надежность переводов. В современном мире именно тщательный анализ данных позволяет добиться максимальных результатов, расширить возможности моделей и адаптировать их под самые разные задачи;

Будущее технологий машинного перевода связано с развитием методов автоматического анализа данных, использовании больших данных и применением передовых методов машинного обучения. Только так мы сможем создавать системы, которые не просто переводят слова, а передают смысл, эмоции и культуру на другом языке.

Вопрос: Почему такой тщательный анализ данных считается ключевым компонентом разработки нейронных переводческих систем?

Подробнее

| анализ данных для NMT | примеры обработки данных | методы визуализации данных | инструменты анализа текста | эффективные кейсы применения анализа |

| выборка данных для обучения NMT | методы очистки текстов | статистический анализ текстовых корпусов | обнаружение ошибок в данных | оптимизация данных для модели |

| методы балансировки данных | использование метаданных | выявление нерелевантных данных | обработка специализированных корпусам | повышение точности моделей NMT |