- Как использовать трансформеры: полный гид для новичков и не только

- Что такое трансформеры и с чего всё началось?

- Основные идеи‚ заложенные в трансформерах

- Структура трансформерной модели

- Энкодер: преобразование входных данных

- Декодер: генерация результата

- Как работают механизмы внимания?

- Основные типы внимания

- Обучение и применение трансформеров

- Плюсы и минусы трансформеров

- Примеры применения трансформеров в жизни

- Будущее трансформеров

Как использовать трансформеры: полный гид для новичков и не только

В последние годы трансформеры завоевали все области искусственного интеллекта и машинного обучения. От обработки естественного языка до компьютерного зрения — эти мощные модели изменили подход к решению сложных задач. Мы решили разобраться‚ что такое трансформеры‚ как они работают и как их можно применять в разных сферах. В этой статье мы постараемся объяснить всё максимально понятно и интересно‚ чтобы даже начинающие специалисты смогли окунуться в этот захватывающий мир.

Что такое трансформеры и с чего всё началось?

На протяжении многих лет исследователи в сфере искусственного интеллекта сталкивались с необходимостью обработки последовательных данных: текста‚ временных рядов‚ аудио и видео. Для этого использовались такие модели как рекуррентные нейронные сети (РНС) и LSTM‚ но они имели свои ограничения — долгое обучение‚ проблема исчезающего градиента и ограниченная способность к параллельной обработке.

В 2017 году команда Google Brain опубликовала статью‚ которая кардинально изменила подходы к обработке последовательностей — «Attention Is All You Need». В ней была предложена модель трансформер‚ которая стала прорывом благодаря возможностям масштабирования‚ скорости обучения и эффективности.

Основные идеи‚ заложенные в трансформерах

Главная концепция — механизм внимания (attention). Он позволяет модели сосредотачиваться на наиболее важной части входных данных при обработке каждого элемента последовательности. Таким образом‚ трансформеры умеют учитывать контекст гораздо лучше‚ чем предыдущие модели.

Теперь кратко рассмотрим ключевые компоненты трансформера:

- Механизм внимания: определяет‚ на что последнее слово или символ в последовательности обращать внимание.

- Мультиголовное внимание: позволяет модели одновременно учитывать разные аспекты входных данных.

- Позиционная кодировка: помогает модели понять порядок элементов — ведь трансформеры не «знают» о последовательности по умолчанию.

Структура трансформерной модели

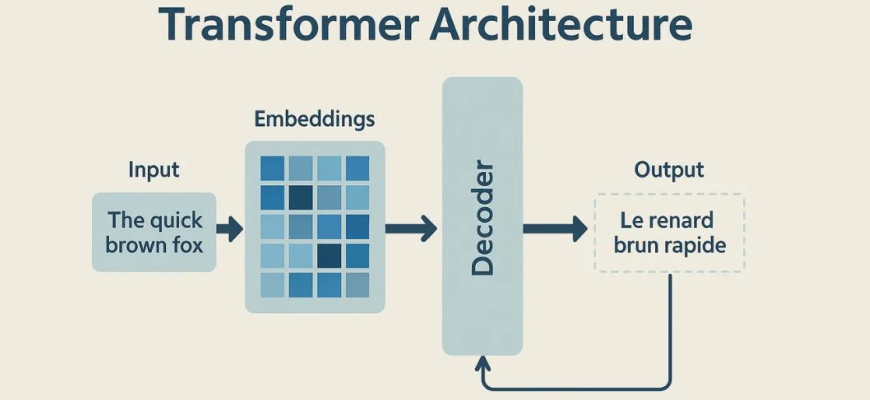

Чтобы понять‚ как же работают трансформеры‚ разберем их архитектуру более подробно. Основная модель делится на два больших блока:

- Модель энкодера

- Модель декодера

Давайте протестируем каждый из этих компонентов и их функции.

Энкодер: преобразование входных данных

Энкодер принимает исходный сигнал (например‚ предложение) и преобразует его в внутреннее представление. Он состоит из нескольких одинаковых слоев‚ каждый из которых включает:

- Механизм многоголовного внимания;

- Полносвязный слой (feed-forward neural network);

- Нормализацию и остаточные связи.

Параметры модели обучаются так‚ чтобы максимально точно захватывать смысл и контекст исходных данных.

Декодер: генерация результата

Декодер использует внутреннее представление от энкодера для генерации итогового вывода — это может быть перевод текста‚ ответ в чатботе‚ описание изображения и многое другое. Его структура схожа с энкодером‚ но дополнительно включает механизм внимания к выходным данным декодера и его предыдущему состоянию.

Как работают механизмы внимания?

Механизм внимания — сердце трансформеров. Он позволяет модели выбирать‚ какие части входных данных наиболее важны для текущего шага обработки. Представим ситуацию: мы переводим предложение с английского на русский. Для правильного перевода слово «dog» в контексте важен весь остальной текст. Механизм внимания помогает модели понять эту взаимосвязь.

Основные типы внимания

| Тип внимания | Описание | Где используют |

|---|---|---|

| Self-attention | Модель обращает внимание на все части входных данных‚ чтобы определить их важность для текущего элемента. | Внутри трансформеров‚ переводе‚ обработке текста. |

| Encoder-Decoder attention | Декодер обращает внимание на выходы энкодера‚ чтобы сгенерировать ответ. | Машинный перевод‚ диалоговые системы. |

| Multi-head attention | Несколько потоков внимания работают одновременно‚ фокусируясь на разных аспектах информации. | В трансформерах‚ моделях выделения признаков; |

Обучение и применение трансформеров

Обучать трансформеры можно на больших объемах данных с помощью градиентного спуска. После обучения такие модели можно применять для разных задач:

- Обработка естественного языка (перевод‚ суммирование‚ ответ на вопросы);

- Анализ изображений и видео (например‚ Vision Transformer — ViT);

- Генерация текста (создание статей‚ рассказов и сценариев).

Плюсы и минусы трансформеров

| Преимущества | Недостатки |

|---|---|

|

|

Примеры применения трансформеров в жизни

Практическое использование трансформеров уже широко распространено и приносит реальные результаты. Ниже приведены наиболее яркие области применения:

- Обработка текста: Google Translate‚ чат-боты‚ виртуальные ассистенты, все эти системы работают на базе трансформерных моделей.

- Медицина и биоинформатика: предсказание структуры белков‚ анализ медицинских изображений.

- Визуальные задачи: классификация изображений‚ создание генеративных изображений‚ видеоанализ.

- Игры и симуляции: обучение стратегии и взаимодействия на базе ИИ.

Будущее трансформеров

Трансформеры продолжают развиваться с каждым годом. В обозримом будущем можно ожидать появления более мощных и компактных моделей‚ расширение их возможностей и применение в еще более широких сферах. Исследователи работают над уменьшением требований к ресурсам‚ повышением интерпретируемости и интеграцией трансформеров с другими технологиями.

Вопрос: Почему трансформеры стали таким популярным инструментом в области ИИ?

Ответ: Трансформеры зарекомендовали себя благодаря своей высокой эффективности в обработке последовательных данных‚ способности учитывать контекст в длинных текстах и возможности масштабирования без заметных потерь в скорости обучения. Их архитектура выделяется тем‚ что полностью полагается на механизм внимания‚ избегая ограничений рекуррентных сетей‚ что делает их более гибкими и мощными. В результате‚ они успешно применяются в самых разных областях — от машинного перевода до генерации изображений и даже биоинформатики‚ что и объясняет их популярность.

Подробнее

| Что такое трансформеры и как они работают? | Механизм внимания в трансформерах | Обучение моделей трансформеров | Области применения трансформеров | Плюсы и минусы трансформеров |

| История появления трансформеров | Основные компоненты трансформера | Модель энкодера и декодера | Примеры популярных трансформерных моделей | Будущее трансформеров |