- Как параллельные корпуса формируют будущее нейронного машинного перевода

- Что такое параллельные корпуса и почему они критичны?

- Типы параллельных корпусов и их характеристика

- Как качество данных влияет на нейронный перевод

- Обучение моделей на больших корпусах: преимущества и сложности

- Практические советы по использованию параллельных корпусов

Как параллельные корпуса формируют будущее нейронного машинного перевода

Современные технологии перевода активно развиваются, и одним из ключевых факторов их успеха являются параллельные корпуса․ Но что же такое эти наборы данных, почему они так важны и как они влияют на качество автоматического перевода? В этой статье мы попробуем разобраться во всех нюансах этого вопроса, основываясь на нашем собственном опыте и исследованиях в области обработки естественного языка․

Тема параллельных корпусов — это не просто академическая абстракция, а реальный инструмент, который помогает моделям учиться лучше, точнее и быстрее․ Мы поделимся с вами нашими находками, разберем практические советы и ошибки, которые часто допускают новички, вступая в мир машинного перевода․

Что такое параллельные корпуса и почему они критичны?

Параллельные корпуса — это крупные базы данных, содержащие тексты на одном языке и их точные переводы на другой язык․ Обычно они состоят из двух колонок: оригинальный текст и его перевод, и позволяют моделям учиться ассоциациям между структурами и смысловыми единицами․ Именно благодаря этим корпусам нейронные сети обучаются распознавать связи между различными языками и формируют основы для автоматического перевода․

Для понимания важности давайте взглянем на основные причины, почему параллельные корпуса считаются ключевым элементом в нейронном машинном переводе:

- Обучение модели на примерах: наличие большого количества пар текста помогает сети понять закономерности․

- Стандартизация качества: одинаковый формат и структура данных позволяют усреднить показатели и повысить стабильность системы․

- Поддержка различных языковых пар: разнообразие корпусов расширяет возможности для перевода между редкими и популярными языками․

Большое количество исследований подтверждает, что чем более богатым и качественным является корпус, тем лучше работает модель․ Но не менее важно и качество самих данных, ошибок, неправильных переводов или двусмысленностей в корпусах быть не должно, иначе модель научится ошибкам․

Типы параллельных корпусов и их характеристика

Существует несколько видов параллельных корпусов, каждый из которых предназначен для конкретных задач и типов моделей․ Рассмотрим основные типы:

| Тип корпуса | Описание | Примеры использования | Особенности | Размер |

|---|---|---|---|---|

| Общие корпуса | Много тематические тексты, включающие различные области — новости, статьи, книги․ | Многопоточечный перевод | Обеспечивают широкий охват лексики и стилей | Несколько сотен тысяч до миллионов пар |

| Тематические корпуса | Фокусируются на одной теме — медицина, право, техника․ | Специализированные переводчики | Глубокая проработанность темы | От нескольких тысяч до сотен тысяч пар |

| Обучающие корпуса | Созданы специально для обучения моделей и включают чистые, проверенные пары․ | Подготовка к соревнованиям | Высокое качество данных | Несколько тысяч до десятков тысяч пар |

| Исторические корпуса | Данные с устаревшими или архаическими текстами | Лингвистические исследования | Меньший объем, более сложные для моделей | Несколько тысяч пар |

Выбор типа корпуса зависит от целей проекта, требований к качеству и скорости обучения․ Например, для высокоточной профессиональной системы лучше использовать тематические и обучающие корпуса, а для быстрой начальной оценки, общие наборы данных․

Как качество данных влияет на нейронный перевод

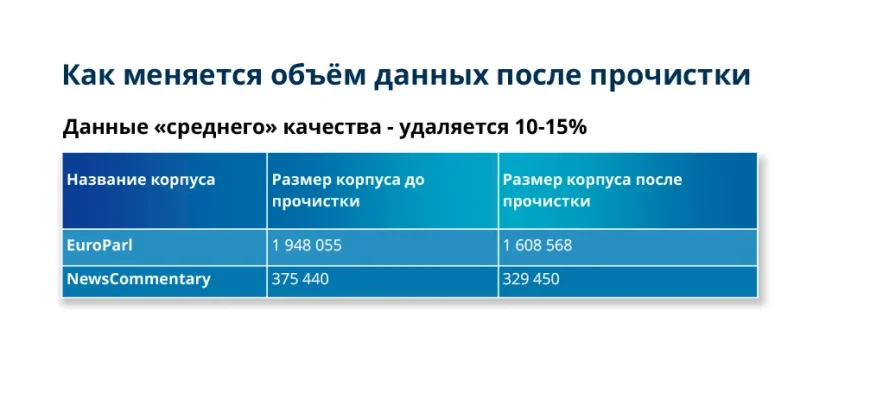

Самое важное – качество корпусных данных․ Даже самые современные нейронные архитектуры не смогут компенсировать отсутствие или искажения информации․ В нашем опыте мы сталкивались с ситуациями, когда неправильные переводы или орфографические ошибки в корпусе приводили к неадекватным результатам в системе․ Это заставляло пересматривать весь процесс сборки и проверки данных․

Давайте выделим основные причины, почему качество корпусов критично:

- Обучение неправильной информации: ошибки в корпусах закрепляются в модели как правильные, ухудшая результат․

- Установка неправильных языковых закономерностей: плохие данные могут научить сеть порочным связям, например, неправильному использованию слов․

- Меньший охват вариантов: низкое качество уменьшает универсальность модели, она либо запоминает шаблоны, либо ошибается при встрече с новыми конструкциями․

Проверка и фильтрация данных — обязательный этап в подготовке корпусов․ Мы рекомендуем использовать автоматические средства и ручной контроль, чтобы повысить уровень точности․ Уделите особое внимание исправлению орфографических ошибок, устранению дублирующихся записей и удалению шумных данных․

Обучение моделей на больших корпусах: преимущества и сложности

Масштабные параллельные корпуса позволяют моделям учиться более полно и детально․ Однако при этом появляется ряд задач, связанных с обработкой огромных объемов данных:

- Время тренировки: большие датасеты требуют значительно больше ресурсов и времени․

- Объем памяти: необходимо наличие высокопроизводительных серверов и систем хранения данных․

- Обработка шумных данных: чем больше данных, тем больше шанс попасть на некорректные примеры․

Несмотря на сложности, преимущества масштабных корпусов очевидны․ Они позволяют повысить качество перевода, расширить лексический запас модели и снизить вероятность переобучения․

Для успешной работы рекомендуется применять методы обучения с выборочными датасетами, уменьшать шумовые данные и внедрять регуляризацию, чтобы модель не переобучалась на случайные ошибки․

Практические советы по использованию параллельных корпусов

Создание и использование параллельных корпусов — это целая наука, и мы хотим поделиться с вами самыми важными практическими советами:

- Постоянное обновление данных: языки живы, поэтому корпуса нужно регулярно пополнять свежими данными․

- Автоматическая фильтрация ошибок: используйте современные алгоритмы для обнаружения и устранения ошибок в данных․

- Разделение данных на обучающие, валидационные и тестовые наборы: это помогает избежать переобучения и оценить модель на независимых данных․

- Использование разных типов корпусов: комбинация общих и тематических данных дает более устойчивый результат․

- Обратная связь с носителями языка: привлечение специалистов помогает улучшить качество перевода и исправить ошибочные данные․

Вопрос: Почему качество параллельных корпусов так важно для нейронных моделей и что случится, если данные будут низкого качества?

Ответ: Качество данных определяет, на чем обучается модель․ Если в корпорах есть ошибки, неправильные переводы или шум, модель усвоит эти ошибки и начнет выдавать некорректные или неточные переводы․ Это снизит доверие к системе и усложнит использование в профессиональных целях․ Поэтому очень важно внимательно проверять и очищать корпуса, чтобы обучение происходило на максимально точных и структурированных данных․ Только при высоком качестве исходных данных нейронные сети смогут достигнуть своих лучших результатов и стать надежными инструментами для автоматического перевода․

Итак, мы убедились, что параллельные корпуса не просто важны, а являются основой эффективного и точного нейронного машинного перевода․ Чем лучше качество, чем разнообразнее и актуальнее данные, тем больше шансов создать систему, способную понимать и переводить сложные конструкции, специфические термины и стили․

Будущее технологий связывается с постоянным развитием и обновлением корпусов, внедрением автоматических методов их очистки и дополнения․ В этом направлении работают ведущие команды в области НЛП, стремясь сделать машинный перевод все более естественным, быстрым и надежным․

Для всех, кто заинтересован в создании своих собственных систем или просто хочет понять, как это работает — наличие хорошего параллельного корпуса и знаний о его правильном использовании — залог успеха․ Не бойтесь экспериментировать, проверяйте качество данных и всегда следите за новыми трендами в области обработки естественного языка․

Подробнее

| примеры параллельных корпусов |

| разработка обучающих корпусов |

| фильтрация данных для моделей |

| тематические параллельные корпуса |

| использование больших корпусов |