- Как размер обучающей выборки влияет на качество нейронных машинных переводов (NMT): глубокий разбор и практические советы

- Основы нейронных машинных переводов и роль больших данных

- Влияние размера обучающей выборки: теоретические основы

- Практическое влияние объема данных на качество системы NMT

- Ключевые закономерности, выявленные в исследованиях

- Недостатки и риски при увеличении данных

- Стратегии расширения обучающего набора данных

- Генерация и аугментация данных

- Использование внешних ресурсов и многоязыковых данных

- Практические советы по оптимизации использования данных

- Что нужно учитывать при сборе и подготовке данных

- Подбор архитектуры и обучение модели

- Примеры успешного использования больших данных в NMT

- Ответ на популярный вопрос: Почему увеличение выборки не всегда ведет к улучшению качества?

- Обзор и подборка дополнительных ресурсов

Как размер обучающей выборки влияет на качество нейронных машинных переводов (NMT): глубокий разбор и практические советы

В современном мире автоматического перевода качество без преувеличения стало одним из ключевых факторов успеха любых систем машинного перевода. Особенно это актуально для нейронных машинных переводов (NMT), которые ежедневно помогают миллионам людей обмениваться информацией на разных языках. Но как именно размер обучающей выборки влияет на эффективность таких систем? Почему иногда увеличение данных не дает желаемого результата, а иногда кардинально улучшает качество перевода? В этой статье мы вместе разберемся, на что влияет объем данных для обучения и как правильно его использовать, чтобы получить максимально точный и естественный перевод.

Основы нейронных машинных переводов и роль больших данных

Перед тем как погрузиться в технические детали, важно понять, что такое системы NMT и зачем им нужны большие объемы данных. Нейронные модели обучения строятся на больших наборах переводов, которые помогают системе понять контекст, стиль и особенности языка. Чем больше и разнообразнее обучающая выборка, тем лучше модель справляется с различными лингвистическими нюансами, идиомами, терминологией и стилями.

Ниже мы рассмотрим, как именно на практике изменяется качество перевода при увеличении объема данных и с какими сложностями можно столкнуться.

Влияние размера обучающей выборки: теоретические основы

На практике существует несколько базовых принципов, которые помогают понять, как влияет объем данных на результат:

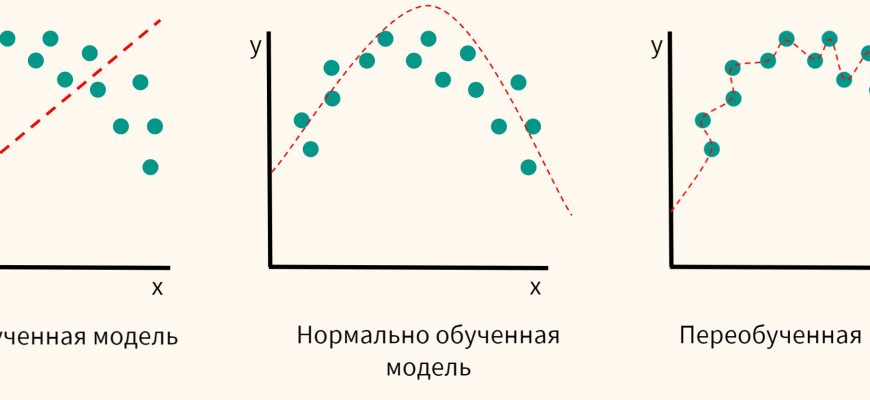

- Закон убывающей отдачи: После определенного объема данных прирост в качестве перевода становится все меньше и меньше. В начале скачок заметен, а затем приближается к плато.

- Общее правило: Большие выборки позволяют лучше моделировать редкие случаи, идиоматические выражения и сложные конструкции.

- Обучение на малых данных: Такие системы часто ограничены в качестве, особенно при сложных задачах и языках с малым количеством обучающих материалов.

Понимание этих принципов помогает определить, когда оправдано увеличение объема данных, а когда лучше сфокусироваться на качестве и разнообразии существующих наборов.

Практическое влияние объема данных на качество системы NMT

Ключевые закономерности, выявленные в исследованиях

Исследования показывают, что увеличение обучающей выборки ведет к следующим результатам:

| Объем данных | Качество перевода | Обнаруженные особенности |

|---|---|---|

| Маленький (до 1 миллиона пар предложений) | Низкое, часто с ошибками и недопониманием контекста |

|

| Средний (от 1 до 10 миллионов пар) | Значительное улучшение качества, появляется понимание контекста |

|

| Большой (свыше 10 миллионов пар) | Высокое качество, приближающееся к человеческому уровню, особенно на популярных языках |

|

Недостатки и риски при увеличении данных

Хотя увеличение обучающей выборки кажется очевидным способом повышения качества, оно также сопряжено с рядом проблем:

- Высокие вычислительные затраты: обработка и хранение больших данных требуют мощных ресурсов.

- Качество данных: большие объемы могут содержать шум, ошибки или нерелевантные записи, что негативно скажется на качестве модели.

- Долгое обучение: чем больше данных, тем дольше время обучения и проверки модели.

Поэтому всегда важно находить баланс между количеством и качеством данных.

Стратегии расширения обучающего набора данных

Генерация и аугментация данных

Чтобы повысить эффективность обучения без необходимости собирать миллионы дополнительных пар предложений, используют методы генерации и аугментации данных:

- Перестановка слов: изменение порядка слов в предложениях, сохраняя смысл.

- Добавление шумов: вставка или удаление отдельных слов, чтобы научить модель распознавать реальную речь в различных условиях.

- Перевод существующих данных: перевод набора данных на другие языки и обратно для повышения разнообразия.

Использование внешних ресурсов и многоязыковых данных

Еще один способ расширения выборки — это подключение внешних источников, таких как параллельные корпуса, базы данных переводов и многоязыческие ресурсы. Это помогает моделировать редкие случаи, повысить устойчивость системы и расширить лингвистическую базу.

Практические советы по оптимизации использования данных

Что нужно учитывать при сборе и подготовке данных

Для получения наилучших результатов важно соблюдать несколько правил:

- Фильтровать шум и ошибки: внимательно проверять данные и удалять нерелевантные или некорректные записи.

- Обеспечивать разнообразие: включать разные жанры, стили, терминологию.

- Балансировать популярные и редкие случаи: чтобы не перекосить модель в сторону типичных выражений.

Подбор архитектуры и обучение модели

- Обучение на меньших выборках: для быстрой оценки — использование меньших подвыборок.

- Масштабирование: увеличение данных по мере необходимости и вычислительных возможностей.

- Эксперименты с разными наборами: тестирование модели на различных объемах данных для определения оптимального баланса.

Примеры успешного использования больших данных в NMT

Реальные кейсы крупных компаний и исследовательских центров показывают, что правильное увеличение объема данных способствует значительному росту качества перевода. Например, Google Translate использует миллионы документов для обучения своих моделей, что позволяет ей легко справляться с редкими и сложными случаями.

Также открытые проекты, такие как OpenNMT или Marian, демонстрируют, что даже небольшие команды могут добиться отличных результатов при правильной работе с большими наборами данных и их качественной подготовке.

Ответ на популярный вопрос: Почему увеличение выборки не всегда ведет к улучшению качества?

Вопрос: Почему иногда, несмотря на значительные усилия по увеличению объемов данных, качество перевода не улучшается или даже ухудшается?

Ответ заключается в том, что добавление большого количества данных без должной очистки, балансировки и выбора релевантных источников может привести к накоплению шумов и нерелевантной информации. Такие данные мешают модели сформировать четкое понимание языка и могут снизить общую точность. Поэтому важен не только объем данных, но и их качество, репрезентативность, а также правильная подготовка.

Обзор и подборка дополнительных ресурсов

Подробнее

| Обучающие корпуса для NMT | Оптимизация данных для перевода | Генерация тренировочных данных | Многоязычные корпуса | Методы увеличения данных |

| Лучшие практики для NMT | Обработка больших данных | Переводящие модели | Источники параллельных корпусов | Оптимизация обучения |

| Методы аугментации данных | Обучение на малых данных | Автоматизированное качество данных | Мультиязычные системы | Обучение нейросетей |

| Обучающие платформы | Поддержка языковых моделей | Обработка больших текстов | Корпусы для редких языков | Обновление обучающих наборов |