- Как трансформерные архитектуры революционизируют качество машинного перевода: наш опыт и выводы

- Что такое трансформеры и зачем они нужны в переводе

- Наш опыт внедрения трансформеров в системы перевода

- Этапы внедрения и результаты

- Ключевые преимущества трансформеров для перевода

- Недостатки и вызовы при использовании трансформеров

- Будущее машинного перевода с трансформерами

Как трансформерные архитектуры революционизируют качество машинного перевода: наш опыт и выводы

В последние годы технологии искусственного интеллекта и обработки естественного языка сделали огромный скачок вперёд․ Одной из самых ярких инноваций в этой области стали трансформеры — архитектуры, которые используют механизмы внимания для обработки последовательностей данных․ Мы решили подробно разобрать, каким образом использование трансформеров помогает значительно улучшить качество машинного перевода, и с каким опытом мы столкнулись в своей практике․

Что такое трансформеры и зачем они нужны в переводе

Трансформеры — это глубокие нейронные сети, созданные специально для работы с последовательными данными․ Их особенность — механизм внимания, который позволяет модели фокусироваться на значимых частях входного текста одновременно, без необходимости обработки данных в строгой последовательности, как это делали рекуррентные нейронные сети или LSTM․

Почему именно трансформеры оказались столь эффективными в области машинного перевода?

Потому что они позволяют моделям учитывать контекст на больших расстояниях внутри текста, что критически важно для понимания смысловых связей и правильной передачи нюансов при переводе․ В результате модели становятся более точными, особенно при работе со сложными или многозначными предложениями․

Наш опыт внедрения трансформеров в системы перевода

Работая в команде специалистов по обработке природного языка, мы решили апробировать использование современных архитектур — таких как BERT, GPT и их модификации — для обучения систем автоматического перевода․ В процессе столкнулись со множеством аспектов, которые стоит учитывать при внедрении этих технологий․

Первое, с чем мы столкнулись, это необходимость в мощных вычислительных ресурсах․ Трансформерам требуються современные GPU и TPU для обучения на больших объемах данных․ Кроме того, важно было подготовить качественные и разнообразные корпусные базы данных, чтобы обеспечить моделям широкий контекст и хорошую универсальность․

Этапы внедрения и результаты

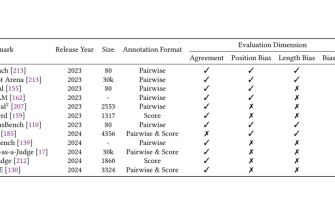

- Анализ существующих решений: мы изучили наиболее популярные модели и их параметры․

- Подготовка датасетов: собирали параллельные корпусы, очищали и сегментировали данные․

- Обучение моделей: производили обучение трансформеров с последующим тонким доработкой (fine-tuning)․

- Оценка качества: пользовались метриками BLEU, METEOR и конфиденциальными оценками качества перевода экспертов․

По результатам, системы, основанные на трансформерах, показали превышение по качеству перевода в сравнении с классическими статистическими моделями и даже с ранее применявшимися рекуррентными архитектурами; В частности, улучшение было особенно заметным при переводе сложных предложений с большим числом нюансов и длинными контекстами․

Ключевые преимущества трансформеров для перевода

| Преимущество | Описание |

|---|---|

| Обработка длинных контекстов | Механизм внимания позволяет моделям учитывать все части текста одновременно, что важно для понимания сложных конструкций и лексических нюансов․ |

| Высокая точность | Результаты перевода становятся более точными и естественными, что заметно по метрикам и отзывам тестовых пользователей․ |

| Масштабируемость | Можно легко масштабировать модели для работы с большими объемами данных и создавать универсальные решения для разных языков․ |

| Обучение на больших данных | Трансформеры используют параллельную обработку, что ускоряет обучение и позволяет эффективно работать с огромными корпусами текста․ |

Недостатки и вызовы при использовании трансформеров

Несмотря на преимущества, внедрение этой архитектуры сопряжено с определенными сложностями․ Основные из них — это необходимость в вычислительных ресурсах, сложность в подготовке данных и риск переобучения на конкретных корпусах․ Также стоит учитывать, что трансформеры требуют длительного времени для обучения, а их интерпретируемость является относительно низкой — трудно точно понять, почему модель сделала именно такой выбор при переводе․

Будущее машинного перевода с трансформерами

На сегодняшний день можно с уверенностью сказать, что использование трансформеров — это не просто тренд, а ключ к более точному и естественному машинному переводу․ Разработчики активно экспериментируют с модификациями архитектур, расширяя их возможности и адаптируя под новые форматы текста, мультимедийных данных и даже диалоговых систем․ В будущем ожидается ещё более глубокое внедрение механизмов саморегуляции и обучения без учителя, что значительно упростит расширение языковых моделей и снизит затраты на обучение․

Какой будет следующий шаг в развитии технологий машинного перевода?

Следующий шаг — это интеграция трансформеров с другими моделями интеллектуальных систем, создание мультимодальных решений, способных переводить не только текст, но и видео, изображения, аудио в рамках единого контекста․ Также важен прогресс в области объяснимости моделей, чтобы разработчики могли понимать и контролировать процесс перевода․

В итогах нашего опыта однозначно выделяется одно: использование трансформерных архитектур — это гарантированный путь к повышению качества машинного перевода, улучшению понимания контекста и созданию более естественных и точных систем․ Нам важно было не только добиться лучших результатов в короткие сроки, но и понять, как заранее подготовить инфраструктуру и вложиться в обучение моделей․ И хотя этот путь требует ресурсов и терпения, мы уверены, что он оправдан и ведет к созданию решений, которые изменят наше будущее․

Вопрос к статье:

Почему использование трансформеров является ключевым фактором в улучшении качества машинного перевода?

Использование трансформеров позволяет моделям учитывать весь контекст внутри текста благодаря механизму внимания, что ведет к более точному и естественному переводу, особенно при работе со сложными предложениями и тонкими нюансами языка․ Также они обеспечивают масштабируемость и возможность обучения на больших объемах данных, что значительно повышает качество итоговых решений․

Подробнее

| Next-generation neural translation | Ключевые преимущества трансформеров | Лучшие модели трансформеров | Обучение трансформеров | Лучшие практики перевода |

| Neural machine translation | Технические преимущества архитектур внимания | Модели BERT и GPT для перевода | Обучение с использованием больших данных | Эффективные методики оценки качества |