- Магия трансформеров: как современные модели меняют подходы к обработке текста и не только

- История появления трансформеров и их первоначальное предназначение

- Основные компоненты архитектуры трансформера

- Почему трансформеры так популярны и чем они лучше своих предшественников

- Трансформеры в практике: основные области применения

- Обработка естественного языка

- Обработка изображений и мультимедиа

- Промышленные решения и финансы

- Современные тренды и будущее трансформеров

- Вопрос: Почему трансформеры считаются одной из ключевых технологий современного мира ИИ?

Магия трансформеров: как современные модели меняют подходы к обработке текста и не только

В последние годы мир искусственного интеллекта стремительно развивается, и одними из главных двигателей этого прогресса стали трансформеры. Эти уникальные модели, впервые представленные в научной работе о трансформерах в 2017 году, произвели революцию в области обработки естественного языка и существенно расширили горизонты возможностей искусственного интеллекта. Мы решили разобраться, что такое трансформеры, почему они так важны и как именно изменяют наш современный мир.

История появления трансформеров и их первоначальное предназначение

Технология трансформеров появилась как инновационный подход к решению задач обработки последовательностей, таких как перевод текста, создание резюме, ответы на вопросы и многие другие. Ранее существенно популярными были рекуррентные нейронные сети (RNN) и их варианты, такие как LSTM и GRU, однако у них были свои ограничения, связанные с обработкой длинных последовательностей и параллелизацией расчетов.

В 2017 году команда исследователей из Google Brain представила новую архитектуру — трансформер, которая отказалась от рекуррентных связей и полностью сосредоточилась на механизмах внимания. Этот шаг открыл новые возможности для моделей, способных обрабатывать большие объемы данных с высокой скоростью и точностью.

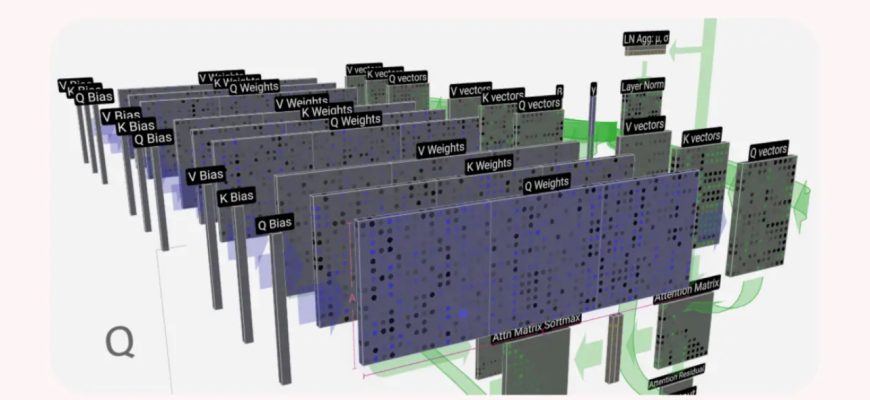

Основные компоненты архитектуры трансформера

Что же делает трансформер настолько уникальным и эффективным? В основе лежит механизм внимания, который позволяет модели фокусироваться на наиболее релевантных частях входных данных. Рассмотрим ключевые компоненты:

| Компонент | Описание |

|---|---|

| Механизм внимания (Attention) | Позволяет модели учитывать важность отдельных элементов входной последовательности и сосредотачиваться на наиболее значимых фрагментах в процессе обработки |

| Многоголовое внимание (Multi-head Attention) | Использует несколько механизмов внимания одновременно, что увеличивает способность модели захватывать разные аспекты информации |

| Энкодер и декодер | Классическая структура трансформера, которая позволяет сначала обработать входные данные, а затем преобразовать их в нужный формат вывода |

| Позиционное кодирование | Добавляется к входным данным для учета порядка элементов, так как архитектура сама по себе не содержит рекуррентных связей |

Почему трансформеры так популярны и чем они лучше своих предшественников

Главным достоинством трансформеров является возможность обработки длинных последовательностей без потери контекста, что ранее было сложно реализовать с помощью RNN или CNN. Благодаря механизму внимания они обеспечивают лучшее понимание структуры текста, а также значительно увеличивают скорость обучения и генерации результатов.

Именно эта эффективность привела к появлению таких успешных моделей, как BERT, GPT и их разновидности, каждый из которых нацелен на выполнение конкретных задач с высокой точностью. В результате, трансформеры оказались не только популярными, но и практически незаменимыми во многих сферах:

- Обработка естественного языка (понимание и генерация текста)

- Перевод текстов между языками

- Распознавание речи

- Обработка изображений (например, Vision Transformer)

- Обработка видео и мультимедиа контента

Трансформеры в практике: основные области применения

Разработчики и исследователи уже давно поняли потенциал трансформеров, и сегодня их используют во многих областях. Ниже представлены наиболее яркие примеры того, где и как эти модели применяются:

Обработка естественного языка

Здесь трансформеры демонстрируют высокие результаты в задачах:

- Автоматического перевода текста — например, Google Translate использует трансформеры для повышения точности переводов.

- Автоматического составления резюме — LLM (большие языковые модели) помогают быстро и точно структурировать информацию.

- Ответов на вопросы — системы, такие как ChatGPT, используют архитектуры на базе трансформеров для ведения диалогов и генерации контента.

Обработка изображений и мультимедиа

Модели Vision Transformer (ViT) позволяют обрабатывать изображения с помощью архитектуры, основанной на трансформерах, достигая результатов, сравнимых с лучшими CNN.

Промышленные решения и финансы

Модели на базе трансформеров используются для анализа больших массивов данных, автоматизации процессов и даже в системах поддержки принятия решений.

Современные тренды и будущее трансформеров

Сегодня ощущается постоянный рост числа новых решений и модификаций трансформеров, что говорит о беспрецедентной их универсальности и потенциале. Среди трендов можно выделить:

- Малые, специально обученные трансформеры для мобильных устройств и встроенных систем

- Многомодельные системы для комплексных задач (например, объединение текста и изображений)

- Обучение на меньших объемах данных — важный аспект для практических приложений

Будущее этих технологий связано с дальнейшей интеграцией в различные сферы нашей жизни, повышение эффективности и снижение вычислительных затрат.

Вопрос: Почему трансформеры считаются одной из ключевых технологий современного мира ИИ?

Ответ: Потому что они позволяют достигать высокой точности и скорости обработки данных без существенных ограничений по длине последовательностей и с возможностью параллельной обработки. Это существенно расширяет возможности искусственного интеллекта, делая его более универсальным и эффективным в масштабных задачах, что в конечном итоге влияет на множество сфер — от медицины и финансов до развлечений и робототехники.

Подробнее

| Трансформеры в NLP | Механизм внимания | Обучение трансформеров | GPT модели | Vision Transformer |

| Обработка изображений трансформерами | Будущее трансформеров | Обучение с малым количеством данных | Мульти-модальные модели | Автоматический перевод текста |