- Обширный анализ данных для нейронных машинных переводов: как сделать перевод более точным и естественным

- Что такое анализ данных для NMT и почему он важен?

- Этапы анализа данных для NMT

- Сбор и агрегирование данных

- Очистка и предобработка данных

- Лингвистический и статистический анализ

- Создание и обработка параллельных корпусов

- Анализ когнитивных и стилистических факторов

- Инструменты и методы анализа данных для NMT

- Инструменты для сбора и очистки данных

- Методы статистического анализа и визуализации

- Обработка параллельных корпусов

- Практические советы по анализу данных для построения мощных NMT моделей

Обширный анализ данных для нейронных машинных переводов: как сделать перевод более точным и естественным

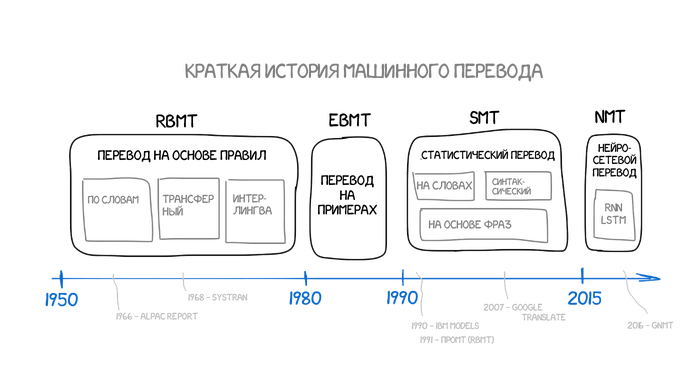

В современном мире, где глобализация идет быстрыми темпами, способность переводить тексты с одного языка на другой становится неотъемлемой частью коммуникации. Самым революционным в развитии этого направления стал нейронный машинный перевод (NMT – Neural Machine Translation). Однако, чтобы повысить его качество, необходимо хорошо разбираться в анализе данных, составляющих основу этой технологии.

Мы вместе погрузимся в захватывающий мир обработки и анализа данных для NMT, рассмотрим ключевые этапы, стратегии и инструменты, которые помогают сделать автоматический перевод максимально точным, плавным и естественным. От подготовки обучающего корпуса до тонкой настройки моделей — каждый этап важен и требует особого внимания.

Что такое анализ данных для NMT и почему он важен?

Обработка и анализ данных для нейронных машинных переводов — это комплекс процедур, позволяющих подготовить, структурировать и оптимизировать набор данных, используемый для обучения моделей. Эти этапы критичны, потому что именно качество и структура данных определяют эффективность и точность перевода.

Если рассматривать процесс более подробно, то он включает в себя:

- Сбор данных — добыча больших объемов текстовой информации на исходном и целевом языках.

- Очистку данных — удаление ошибок, дублей, однородных фрагментов.

- Анализ лингвистических особенностей — учет морфологических, синтаксических и стилистических характеристик.

- Анализ статистических свойств — частотность слов, модели распределения, биграммы и т.п.

Продемонстрируем всю важность этих аспектов: хорошо структурированные и аналитически подготовленные данные, залог высокоточной и естественной работы NMT-моделей. Именно поэтому так важен грамотный анализ данных на этапе подготовки.

Этапы анализа данных для NMT

Разделим процесс анализа данных на несколько ключевых этапов, каждый из которых важен для достижения высокой эффективности модели.

Сбор и агрегирование данных

На этом этапе осуществляется сбор огромных объемов текстов на исходных и целевых языках. Обычно используют:

- Крупные корпусные базы данных

- Открытые источники, такие как Wikipedia, Common Crawl

- Специализированные корпуса для доменной специфики

Очистка и предобработка данных

Этот процесс включает:

- Удаление дубликатов

- Исправление ошибок — орфографических и пунктуационных

- Нормализацию текста, приведение к единому стилю, устранение лишних пробелов, знаков

- Реализация сегментации — разбиение текста на предложений и слова

Эстетика и чистота данных обеспечивают лучшую обучаемость модели.

Лингвистический и статистический анализ

На этом этапе изучают особенности языков и их статистические свойства, что помогает понять, как лучше построить модель. Ключевые аспекты:

- Изучение частотности слов и выражений

- Анализ биграмм, триграмм

- Определение сложных лингвистических структур

Создание и обработка параллельных корпусов

Параллельные корпуса — это две или более языковых версии одних и тех же текстов, что позволяют моделям быстро обучаться и находить соответствия. Важные аспекты:

- Точное соответствие оригинала и перевода

- Достаточный объем корпусных данных

- Разнообразие тематик и стилей

Анализ когнитивных и стилистических факторов

Для повышения качества перевода необходимо учитывать не только лингвистические особенности, но и стилистические нюансы. Например, использование жаргона, сленга или официальных выражений.

Инструменты и методы анализа данных для NMT

Эффективное выполнение всех вышеперечисленных этапов требует использования специальных инструментов и методов, позволяющих автоматизировать и повышать качество анализа.

Инструменты для сбора и очистки данных

| Инструмент | Описание | Преимущества | Примеры использования |

|---|---|---|---|

| BeautifulSoup | Библиотека Python для парсинга веб-страниц | Автоматизация сбора данных из веб-источников | Извлечение текстов с сайтов |

| NLTK | Библиотека для обработки естественного языка | Очистка, сегментация, анализ текста | Предобработка корпусных данных |

| SpaCy | Высокоэффективная библиотека NLP | Работа с морфологией, лемматизацией | Анализ лингвистических особенностей |

Методы статистического анализа и визуализации

- Использование Python-библиотек Matplotlib и Seaborn для построения графиков распространенности слов и биграмм.

- Создание тепло-карт для выявления наиболее часто используемых сочетаний.

- Использование табличных структур для сравнения частотностей и распределений.

Обработка параллельных корпусов

При работе с параллельными корпусами необходимо учитывать:

- Совместимость форматов данных

- Правильное выравнивание предложений

- Балансировки объемов для различных тематик

Инструменты для этой задачи включают Giza++, Moses, и специализированные алгоритмы выравнивания.

Практические советы по анализу данных для построения мощных NMT моделей

В ходе работы мы накопили богатый опыт, которым делимся ниже. Успех модели во многом зависит от правильности анализа данных.

- Всегда начинайте с очистки данных. Не допускайте ошибок и шумов, иначе, плохое качество перевода.

- Используйте разнообразный корпус. Чем больше тематик, тем лучше модель учитывает широкий спектр языковых особенностей.

- Обратите внимание на баланс сторон. Не позволяйте одному языку доминировать — это снизит качество перевода.

- Регулярно проверяйте статистические свойства. Частотности, биграммы помогают понять, как устроен язык.

- Используйте автоматические инструменты анализа для быстрого выявления проблем и трендов.

Следя за всеми этими аспектами, мы значительно повышаем шансы построить действительно качественную модель NMT, способную понимать и переводить текст так же, как это делает человек.

Погружение в анализ данных — это основа всей работы по созданию эффективных систем автоматического перевода. Чем глубже мы изучаем лингвистические, статистические и смысловые особенности наших корпусов, тем лучше учимся моделировать языковые связи и нюансы. В итоге, наш перевод становится не только точным, но и естественным, приближенным к человеческому уровню.

Помните: качественный анализ данных — это не разовая операция, а постоянный процесс мониторинга и совершенствования. Только так можно добиться действительно высокого результата и обеспечить долгий успех нейронных систем в сфере перевода.

Вопрос: Как анализ данных помогает повысить качество нейронного машинного перевода?

Анализ данных позволяет выявить ключевые лингвистические особенности, устранить шумы и ошибки, сбалансировать спектр данных и подготовить корпус таким образом, чтобы модель могла лучше понять структуру и смысл языка. Чем лучше подготовлены данные, тем более естественным и точным становится перевод.

Подробнее

| Обучение моделей NMT | Обработка больших данных | Парсинг текстов для NMT | Статистический анализ языков | Создание параллельных корпусов |

| Обработка естественного языка | Корпусные базы данных | Инструменты для анализа текста | Лингвистические особенности языков | Выравнивание предложений |

| Методы визуализации данных | Техническая подготовка корпуса | Обработка биграмм и триграмм | Анализ частотности слов | Оптимизация данных для обучения |

| Автоматизация анализа текстов | Лингвистические особенности | Обработка ошибок и шумов | Подготовка для машинного обучения | Контроль качества данных |