- Всё о использовании трансформеров: что нужно знать современному исследователю и разработчику

- История возникновения и развитие трансформеров

- Как работают трансформеры: основные компоненты

- Механизм внимания (Self-Attention)

- Мультиголовное внимание (Multi-Head Attention)

- Позиционная кодировка (Positional Encoding)

- Основные слои и структура трансформера

- Преимущества использования трансформеров в сравнении с предыдущими моделями

- Как правильно использовать трансформеры в своих проектах?

- Выбор модели под задачу

- Настройка и дообучение

- Инфраструктура и ресурсы

- Интеграция и API

- Практические примеры использования трансформеров

- Обработка текстов и чат-боты

- Перевод текстов

- Резюмирование и извлечение информации

- Обработка изображений и мультимедийных данных

- Рассмотрим пример: создание собственного проекта с трансформером

- Перспективы и будущее трансформеров

- Общий итог и ключевые выводы

- Вопрос и ответ

Всё о использовании трансформеров: что нужно знать современному исследователю и разработчику

За последние годы архитектура трансформеров кардинально изменила подходы к обработке естественного языка, компьютерному зрению и даже темам, связанным с генерацией текста и искусственным интеллектом в целом. Мы можем с уверенностью сказать, что именно благодаря трансформерам появились такие революционные модели, как GPT, BERT, T5 и многие другие, которые продолжают покорять вершины доверия и эффективности в различных задачах. В этой статье мы подробно расскажем о том, что такое трансформеры, как они работают, в чем их преимущества и как их правильно использовать в своих проектах.

История возникновения и развитие трансформеров

До появления трансформеров большинство моделей обработке естественного языка основывались на рекуррентных нейронных сетях (RNN) и их вариациях, таких как LSTM и GRU. Эти архитектуры имели свои преимущества, но при этом подходили только для относительно небольших последовательностей, а обучение было очень ресурсоемким. В 2017 году команда исследователей из компании Google представила архитектуру трансформеров в своей статье "Attention is All You Need". Этот прорыв ознаменовал новую эпоху: трансформеры не требовали последовательной обработки данных, что значительно ускорило процессы обучения и повысило качество работы моделей.

Появление трансформеров открыло новые горизонты для обработки больших массивов данных и расширило возможности автоматической генерации текста. Эти модели успешно адаптировались для задач перевода, суммаризации, генерации текстов и даже для обработки изображений и видео. Сегодня мы станем рассказывать о принципах их работы, преимуществах и потрясающих возможностях применения.

Как работают трансформеры: основные компоненты

Ключевая особенность трансформеров — механизм внимания (attention), который позволяет модели сосредотачиваться на разных частях входных данных и обрабатывать их параллельно. В основе архитектуры лежит несколько компонентов, которые обеспечивают эффективность и универсальность нейросети.

Механизм внимания (Self-Attention)

Механизм внимания позволяет модели определять, какие части входных данных наиболее важны для текущей обработки. Например, при переводе предложения он помогает понять взаимосвязь между словами, разделёнными расстоянием или контекстом. Этот механизм основан на вычислении весов, которые указывают степень важности каждого элемента в последовательности относительно другого.

| Ключевой компонент | Описание |

|---|---|

| Query, Key, Value (Q, K, V) | Это три набора векторов, используемых для вычисления внимания. Они помогают определить, насколько один элемент важен для другого. |

| Механизм внимания | Производится подсчет весов внимания, с помощью которых формируется взвешенная сумма входных данных, что обеспечивает фокусировку на наиболее релевантных частях. |

Мультиголовное внимание (Multi-Head Attention)

Одной из ключевых инноваций трансформеров стало использование нескольких "голов" внимания одновременно. Это позволяет модели учитывать разные аспекты входных данных и объединять их для более точного понимания контекста. Каждая "голова" работает независимо, фокусируясь на своих особенностях, а затем результаты объединяются и проходят через последующие слои модели.

Позиционная кодировка (Positional Encoding)

Поскольку трансформеры обрабатывают входные данные параллельно, им необходимо знать порядок элементов. Для этого используют позиционные кодировки — специальные векторы, которые добавляются к входным признакам и помогают модели понять расположение слов или элементов в последовательности.

Основные слои и структура трансформера

- Энкодер (Encoder) — принимает данные и преобразует их, создавая внутренние представления, которые передаются дальше.

- Декодер (Decoder) — использует эти представления для генерации результата, будь то перевод, текст или другое содержимое.

- Механизм внимания — интегрирован в различные уровни энкодера и декодера для максимальной эффективности.

Преимущества использования трансформеров в сравнении с предыдущими моделями

| Преимущество | Описание |

|---|---|

| Параллельная обработка | Трансформеры обрабатывают всю последовательность одновременно, что значительно ускоряет обучение. |

| Улучшенное понимание контекста | Механизм внимания позволяет моделям учитывать важные связи между слова и в целом лучше понимать смысл. |

| Масштабируемость | Трансформеры хорошо работают на больших датасетах, расширяя свои возможности по мере роста данных. |

| Гибкость применения | Могут использоваться в разностных задачах: перевод, анализ настроений, ответ на вопросы, генерация текста и др. |

| Обучение на больших данных | Позволяют создавать огромные модели (например, GPT-3), что повышает их качество и универсальность. |

Как правильно использовать трансформеры в своих проектах?

Использование трансформеров требует грамотного подхода и понимания особенностей задач. Ниже мы расскажем о нескольких ключевых моментах для успешной работы с этими моделями.

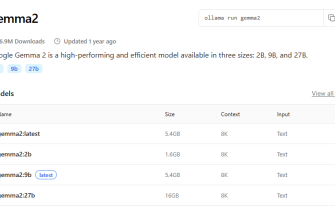

Выбор модели под задачу

Первым шагом является понимание, какая конкретно модель подойдет для вашей задачи. Например, для генерации текста лучше использовать GPT, а для задач извлечения информации — BERT или его вариации.

Настройка и дообучение

В большинстве случаев не стоит сразу использовать модели "из коробки". Важно дообучить их на собственных данных для повышения точности и релевантности.

Инфраструктура и ресурсы

Модели трансформеров требуют серьезных вычислительных ресурсов, особенно если речь идет о больших моделях. Выбирайте подходящую инфраструктуру — облачные сервисы, GPU/TPU или локальные мощности.

Интеграция и API

Многие современные модели доступны через API или библиотеки, такие как Hugging Face Transformers. Это значительно упрощает интеграцию и ускоряет разработку.

Практические примеры использования трансформеров

Обработка текстов и чат-боты

Одной из самых популярных областей применения трансформеров является создание интеллектуальных чат-ботов и систем автоматической обработки писем и запросов клиентов. Здесь важна способность модели понимать смысл и контекст, отвечать близко к человеческому стилю.

Перевод текстов

Модели типа MarianMT, основанные на трансформерах, уже сейчас позволяют переводить тексты с высокой точностью, активно конкурируя с человеческим переводом.

Резюмирование и извлечение информации

Для автоматического создания кратких обзоров или выделения ключевых моментов текста используют модели типа T5 или BART, которые отлично справляются с задачами резюмирования.

Обработка изображений и мультимедийных данных

Недавние исследования используют трансформеры в области компьютерного зрения, расширяя их применение за пределы текста.

Рассмотрим пример: создание собственного проекта с трансформером

Давайте разберем, как начать работу с моделью трансформера шаг за шагом:

- Определение области задачи: например, создание чат-бота для службы поддержки.

- Выбор модели: подойдет GPT или аналогичная модель.

- Подготовка данных: сбор и разметка диалогов или текстов, которые модель будет обучать.

- Настройка инфраструктуры: подготовка серверов с GPU или аренда облачной платформы.

- Обучение модели: запуск процесса обучения, мониторинг метрик.

- Тестирование и внедрение: проверка качества, интеграция в продукт.

Это лишь общий план. На практике потребуется больше нюансов, погружения и экспериментов, но понимание общей картины поможет вам не заблудиться в этом увлекательном мире.

Перспективы и будущее трансформеров

Современные исследования показывают, что архитектура трансформеров продолжает развиваться быстрыми темпами. Ожидается появление новых вариаций — более легких, энергоэффективных и способных работать с мультимедийными данными. Также гибридные модели, сочетающие трансформеры с другими видами нейросетей, могут значительно расширить возможности искусственного интеллекта в будущем.

Параллельно развивается область explainability — объяснимости решений моделей. Это важный аспект для использования трансформеров в критичных сферах, таких как медицина, финансы и право.

Общий итог и ключевые выводы

- Трансформеры — революционная архитектура, которая изменяет подходы в машинном обучении и обработке данных.

- Принцип работы основывается на механизме внимания, что делает модели очень чувствительными к контексту и взаимосвязям.

- Использование трансформеров дает конкурентные преимущества в скорости, точности и масштабируемости решений.

- Для успешной работы важно правильно подобрать модель, инфраструктуру и подготовить данные.

Вопрос и ответ

Вопрос: Почему использование трансформеров считается революционным событием в области искусственного интеллекта?

Ответ: Потому что архитектура трансформеров позволяет моделям лучше понимать сложные взаимосвязи внутри данных без необходимости последовательной обработки, что значительно ускоряет обучение и повышает качество результатов. Благодаря механизму внимания, трансформеры достигают уровня, недостижимого для более старых моделей, что открыло новые горизонты для разработки интеллектуальных систем. Этот подход позволил создать множество мощных моделей, способных выполнять широкий спектр задач: от перевода текста до генерации контента и обработки изображений, что значительно расширяет возможности искусственного интеллекта и меняет представление о его потенциале.

Подробнее

| Что такое трансформеры | Механизм внимания в трансформерах | Преимущества трансформеров | Обучение трансформеров | Примеры моделей трансформеров |

| Трансформеры в NLP | Использование GPT | Обработка изображений трансформерами | Обучение без учителя | Лучшие практики |

| API для трансформеров | Библиотеки для работы с трансформерами | Облака и инфраструктура | Масштабируемость моделей | Проблемы и вызовы |